简介

编辑基金会模型是一个大型的人工智能模型,在大规模的无标签数据上进行训练(通常是通过自我监督学习),形成一个可以适应广泛的下游任务的模型。自2018年推出以来,基础模型是人工智能系统构建方式的重大变革的背后。

基础模型的早期例子是大型预训练的语言模型,包括BERT和GPT-3。利用同样的想法,使用其他种类的标记序列的特定领域模型,如医疗代码,也已经建立。随后,几个多模态基础模型已经产生,包括DALL-E、Flamingo和Florence。

斯坦福大学以人为本的人工智能研究所的基础模型研究中心(CRFM)普及了这个术语。

基金会模型的定义

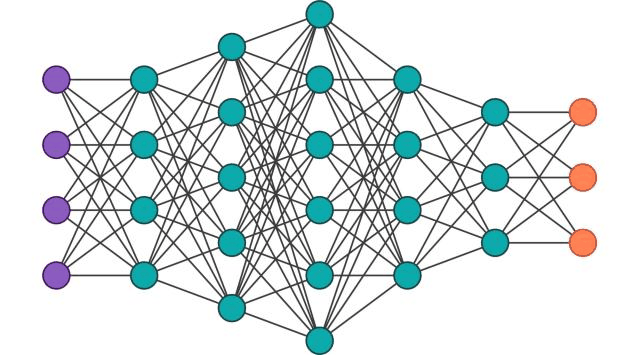

编辑斯坦福大学以人为本的人工智能研究所的基础模型研究中心(CRFM)创造了基础模型这个术语,指的是任何在广泛的数据上训练出来的模型(一般使用规模化的自我监督),可以适应(例如,微调)广泛的下游任务。

斯坦福大学的研究小组认为,这本身并不是一项新技术,因为它是基于深度神经网络和自我监督学习的,但它在过去几年中的发展规模,以及一个模型可用于许多不同目的的潜力,需要一个新术语。

基础模型是一种建立人工智能系统的范式,在这种范式中,一个在大量无标签数据上训练的模型可以适应许多应用。

基础模型被设计为通过对广泛的数据进行规模化的预训练,以适应(例如,微调)各种下游的认知任务。

基础模型的关键特征是涌现和同质化。因为训练数据不是由人类标记的,所以模型是出现的,而不是被明确编码的。没有预料到的属性会出现。

例如,一个在大型语言数据集上训练的模型可能会学习生成自己的故事,或者做算术,而不需要明确的编程来做。同质化意味着同样的方法被用于许多领域,这允许强大的进步,但也有可能出现单点故障。

机会和风险2021年的一份arXiv报告列出了基础模型在语言、视觉、机器人、推理和人类互动方面的能力,技术原理,如模型架构、训练程序、数据、系统、安全、评估和理论,它们的应用。

内容由匿名用户提供,本内容不代表vibaike.com立场,内容投诉举报请联系vibaike.com客服。如若转载,请注明出处:https://vibaike.com/175655/