递归神经网络

编辑递归神经网络是一种深度神经网络,通过在结构化输入上递归应用同一组权重,在可变大小的输入结构上产生结构化预测,或在其上产生标量预测,按拓扑顺序遍历一个给定的结构。递归神经网络,有时缩写为RvNNs,已经成功地在自然语言处理中学习序列和树状结构,主要是基于单词嵌入的短语和句子连续表示。RvNN首先被引入学习结构的分布式表征,如逻辑术语。自20世纪90年代以来,模型和一般框架已经在进一步的工作中得到发展。

递归神经网络的架构

编辑基本

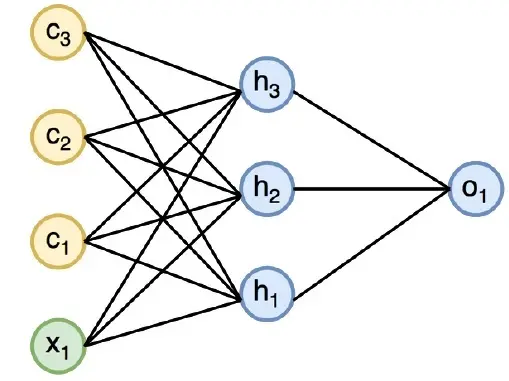

编辑在最简单的架构中,节点使用整个网络共享的权重矩阵和tanh这样的非线性来组合成父节点。如果c1和c2是节点的n维向量表示,它们的父节点也将是一个n维向量,计算公式为这个架构,经过一些改进,已经被用于成功地解析自然场景、自然语言句子的句法解析,以及以立方体抽象的形式对三维形状结构进行递归自动编码和生成性建模。

递归级联关联(RecCC)

编辑RecCC是一种处理树状域的构造性神经网络方法,在化学领域有开创性的应用,并扩展到有向无环图。

无监督的RNN

编辑2004年,一个无监督的RNN框架被引入。

递归神经网络的张量

编辑递归神经张量网络对树上的所有节点使用一个基于张量的组成函数。

递归神经网络的训练

编辑随机梯度下降

编辑通常,随机梯度下降(SGD)被用来训练网络。梯度是通过结构反向传播(BPTS)来计算的,这是一种用于循环神经网络的时间反向传播的变体。文献中已经证明了RNN对树的普遍近似能力。

相关模型

编辑递归神经网络

编辑递归神经网络是具有一定结构的递归人工神经网络:即线性链。递归神经网络对任何层次结构进行操作,将子表征结合到父表征中,而递归神经网络对时间的线性进展进行操作,将前一个时间步骤和一个隐藏表征结合到当前时间步骤的表征中。

树形回声状态网络

编辑在水库计算范式中,树形回声状态网络给出了一种实现递归神经网络的有效方法。

对图的扩展

编辑对图的扩展包括图神经网络(GNN)、图神经网络(NN4G),以及最近的图卷积神经网络。

内容由匿名用户提供,本内容不代表vibaike.com立场,内容投诉举报请联系vibaike.com客服。如若转载,请注明出处:https://vibaike.com/176506/