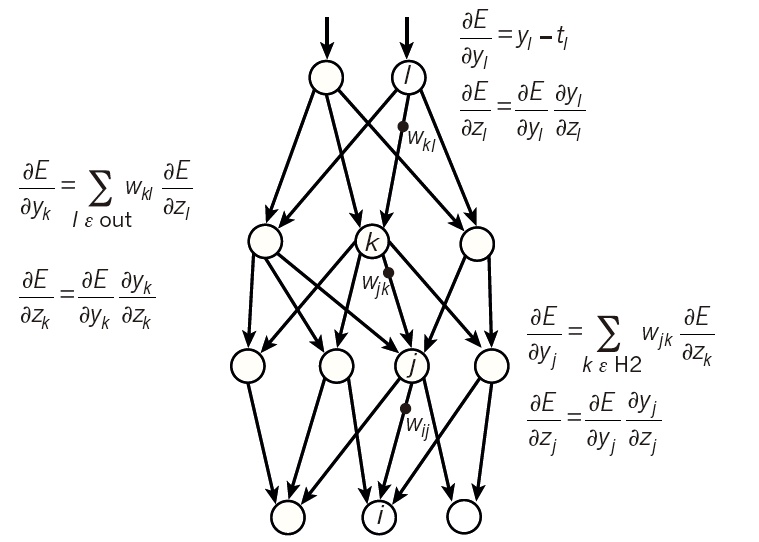

反向传播

编辑反向传播(传播Gosagyaku法)是机器学习中,该神经网络中列车中使用的算法是。1986年到向后传播误差的(向后误差传播从基本上)大卫鲁梅哈特由人名为。

反向传播限制

编辑- 通过反向传播进行学习的融合非常缓慢。

- 通过反向传播学习并不总是收敛。

- 它通常会收敛到局部的最小错误点,而不是全局的最佳解决方案。

- 在某些情况下,需要对输入数据进行预处理。输入必须在激活功能的范围内。如果每个维度的方差之间的差异太大,则权重倾向于集中在方差较小的地方。

- 如果梯度甚至在一个位置消失,则学习不会在较低的层进行,因此,随着层数的增加,梯度消失的可能性也会增加。

- 如果您使用的激活函数的渐变部分接近0,则渐变会轻易消失。

- 由于通过最小化误差来近似任意函数,因此无法学习不遵循中心极限定理的数据。

内容由匿名用户提供,本内容不代表vibaike.com立场,内容投诉举报请联系vibaike.com客服。如若转载,请注明出处:https://vibaike.com/102149/