简介

编辑量子神经网络是基于量子力学原理的计算性神经网络模型。关于量子神经计算的第 一个想法是由SubhashKak和RonChrisley在1995年独立发表的,从事量子心智理论,该理论认为量子效应在认知功能中起作用。然而,量子神经网络的典型研究涉及将经典的人工神经网络模型(广泛用于机器学习中的模式识别这一重要任务)与量子信息的优势相结合,以开发更有效的算法。

这些调查的一个重要动机是训练经典神经网络的困难,特别是在大数据应用中。希望量子计算的特点,如量子并行或干扰和纠缠的影响可以作为资源使用。由于量子计算机的技术实现仍处于不成熟的阶段,这种量子神经网络模型大多是理论上的建议,有待于在物理实验中全面实现。

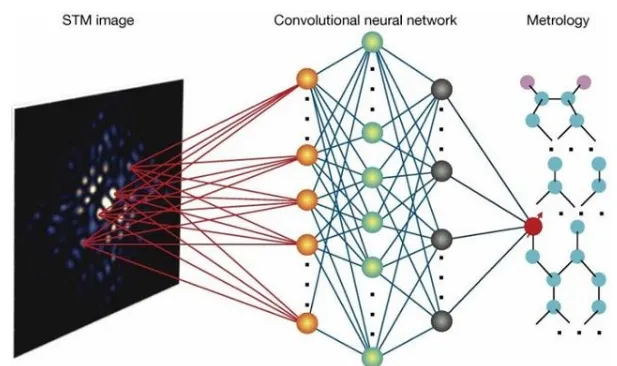

大多数量子神经网络被开发为前馈网络。与它们的经典对应物类似,这种结构从一层量子比特接受输入,并将该输入传递给另一层量子比特。

这一层的量子比特对这些信息进行评估,并将输出传给下一层。最终,这条路通向最后一层的量子比特。各层不必具有相同的宽度,这意味着它们不必与之前或之后的层具有相同数量的量子比特。这种结构被训练成类似于经典的人工神经网络的路径。这将在下面一节中讨论。

量子神经网络指的是三个不同的类别。带有经典数据的量子计算机,带有量子数据的经典计算机,以及带有量子数据的量子计算机。

量子神经网络的例子

编辑量子神经网络研究仍处于起步阶段,已经提出了范围和数学严谨性各不相同的建议和想法的集合体。它们中的大多数都是基于用量子比特(可称为”quron”)取代经典的二进制或McCulloch-Pitts神经元的想法,从而使神经单元可以处于”发射”和”静止”的叠加状态中。

量子感知器

编辑很多建议试图为感知器单元找到一个量子等价物,而神经网就是由感知器单元构建的。一个问题是,非线性激活函数不能立即对应于量子理论的数学结构,因为量子演化是由线性操作描述的,并导致概率性观察。

用量子力学形式主义来模仿感知器激活函数的想法从特殊测量到假设非线性量子算子(一个有争议的数学框架)。最近,Schuld、Sinayskiy和Petruccione基于量子相位估计算法,提出了使用基于电路的量子计算模型直接实现激活函数。

量子网络

编辑在更大范围内,研究人员试图将神经网络推广到量子环境中。构建量子神经元的一种方法是首先泛化经典神经元,然后进一步泛化,使其成为单元门。神经元之间的相互作用可以用单元门进行量子控制,也可以通过测量网络状态进行经典控制。

这种高层次的理论技术可以广泛地应用,通过采取不同类型的网络和不同的量子神经元的实现,如光子实现的神经元和量子水库处理器(水库计算的量子版本)。

大多数学习算法都遵循训练人工神经网络的经典模式,以学习给定训练集的输入输出函数,并使用经典的反馈回路来更新量子系统的参数,直到它们收敛到一个最佳配置。

作为一个参数优化问题的学习也被量子计算的绝热模型所接近。量子神经网络可以应用于算法设计:给定具有可调整的相互作用的量子比特,我们可以尝试按照经典的反向传播规则从所需的输入-输出关系的训练集中学习相互作用,这被认为是所需的输出算法的行为。因此,量子网络”学习”了一种算法。

量子关联记忆

编辑量子关联记忆算法是由DanVentura和TonyMartinez在1999年提出的。作者并没有试图将人工神经网络模型的结构转化为量子理论,而是提出了一种基于电路的量子计算机的算法,模拟关联记忆。

内容由匿名用户提供,本内容不代表vibaike.com立场,内容投诉举报请联系vibaike.com客服。如若转载,请注明出处:https://vibaike.com/167544/